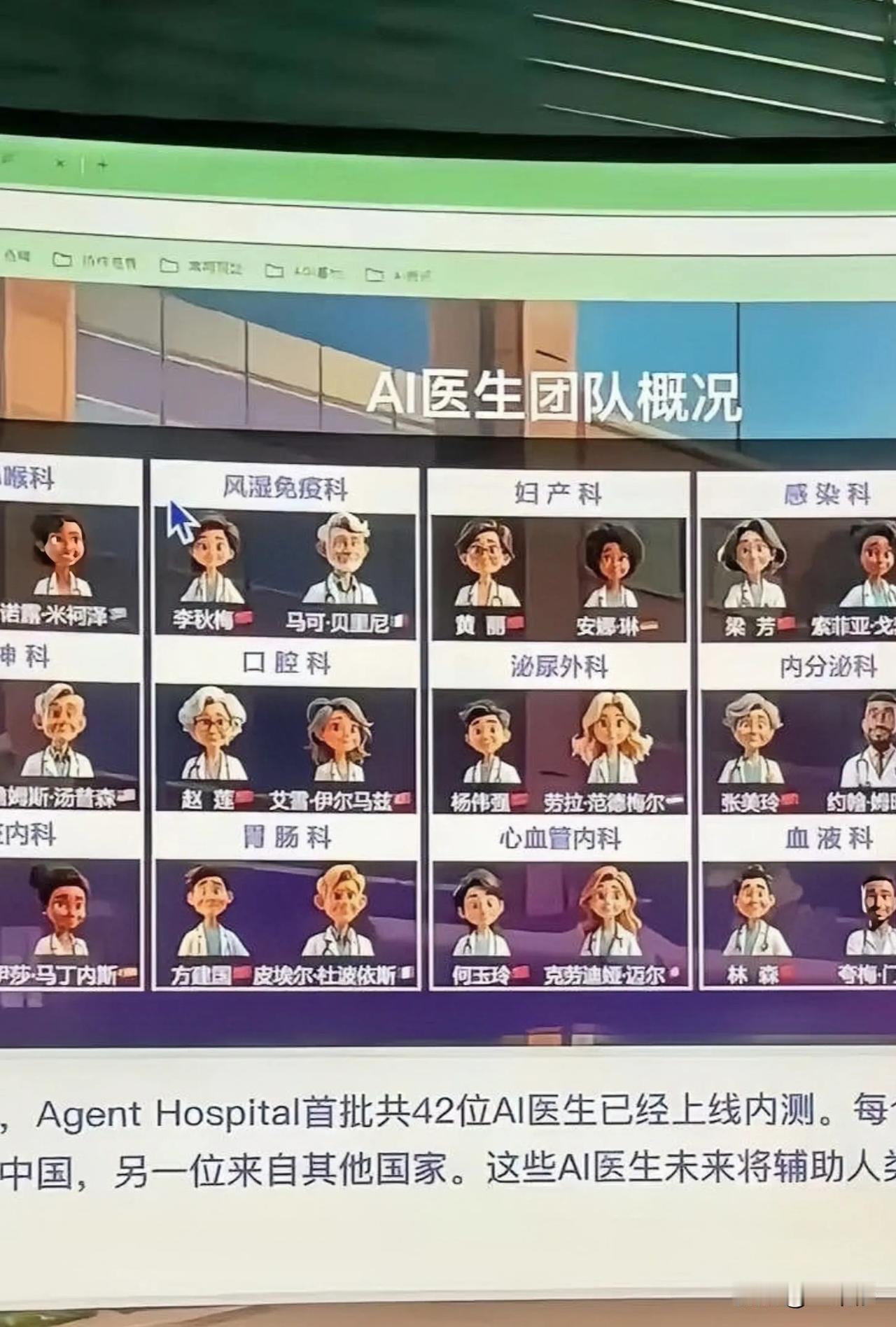

医用机器人开具处方,你敢服吗? AI医生开处方是否可信,需要从技术、法律、伦理和实际应用等角度综合分析。 一、技术层面的可能性与限制 1. 数据驱动的处方生成 医用机器人基于海量医学数据库(如疾病诊疗指南、药物相互作用数据、患者历史病历等),通过算法生成处方。理论上,若能确保数据质量和算法的准确性,其推荐可能比人类医生更少主观偏差,尤其在标准化治疗领域(如高血压、糖尿病)可能更高效。 2. 技术瓶颈 复杂病例的局限性:对罕见病、多系统共病或需结合患者心理社会因素的个体化治疗,AI可能难以处理非结构化信息。 动态更新的滞后性:新药上市、突发公共卫生事件(如未知病原体)的响应速度依赖人工更新数据库。 过度依赖“统计平均”:算法可能倾向推荐“多数人有效”的方案,忽略少数群体的特殊需求。 二、法律与伦理的硬性边界 1. 处方权的归属问题 - 在多数国家(包括中国),现行法律明确规定处方权仅限执业医师。机器人可作为辅助工具,但最终需医生签字确认。 - 若未来法律开放AI处方权,需配套责任认定机制,算法透明化、保险制度。 2. 医疗事故的责任划分 若因算法错误导致伤害,责任可能涉及开发者(算法缺陷)、医院(系统审核失职)、医生(盲目依赖AI)等多方,需明确法律框架。 三、实际应用中的现实场景 1. 现有应用模式 辅助诊断系统:如IBM Watson Oncology已用于肿瘤方案推荐,但实际使用中医生仍主导决策。 慢性病管理:AI监测数据后自动调整胰岛素剂量等,在闭环系统中已有试点。 资源匮乏地区:无执业医师地区可能允许AI紧急开药,但属于权宜之计。 2. 患者的接受度差异 年轻、科技友好群体更易接受,而老年患者可能更依赖医患信任关系。文化差异也会影响接受度(如中医的辨证施治与AI的标准化冲突)。 四、是否“敢吃”的决策建议 一是可信任条件。合规性:处方经执业医师审核并签字。 透明度:AI给出处方的同时提供依据(如引用哪些指南、患者哪些指标符合推荐条件)。 场景适配:适用于常见病、复诊配药等低风险场景。 二需谨慎。首诊、复杂病情、精神类药物等高风险处方。 医疗机构未公开AI系统的训练数据和算法认证信息。 五、未来趋势与平衡之道 1. 人机协同的必然性 AI将逐步承担重复性工作(如用药禁忌筛查、剂量计算),而医生转向综合决策与患者沟通。例如,AI可在1秒内排除上千种药物组合风险,人类医生则评估患者经济承受力、用药依从性等。 2. 如何监管创新 建立AI医疗产品的分级准入制度(如Ⅰ类辅助工具、Ⅱ类有限自主权系统)。 推动“算法解释权”立法,强制医疗机构向患者说明AI决策逻辑。 在现有技术条件下,**完全由AI独立开具且无人工审核的处方,不建议贸然接受**。但在医生监督下、流程合规的AI辅助处方,可以作为一种高效补充。未来的核心并非“是否敢吃”,而是如何通过技术迭代与制度设计,让人工智能的“理性”与医生的“经验”、患者的“个性化需求”达到平衡。

用户10xxx36

西药处方 AI 比医生靠谱! 中医处方 做不到!