DeepSeek做了什么:

【1】验证了新的Scaling Law:在过去的几年间,AI模型的增长主要依靠于预训练阶段的规模堆积,通过对人类已有数据的不断积累,从而增加模型的规模和能力。但随着训练耗尽了人类已有数据,叠加合成数据之路所产生的幻觉icon和边际收益递减问题,预训练阶段的Scaling Law逐渐放缓。2024年以来,基于强化学习的新Scaling Law成为了行业重点方向,先后涌现出了GPT-o1,Deepseek R1等优秀模型。RL这种新的AI增长曲线,在初期展现出了非常高的投入性价比,这也是Deepseek V3快速进化到R1,并展现出强大能力的根本原因。当下RL依然是基于传统的预训练模型,在推理阶段加入RL使得模型面对理科问题时的推理技能更加强大。展望未来,随着RL算法在预训练阶段逐渐取代自回归算法,同时使用更强大的算力和更多的数据,基于RL算法训练模型生成思维链,将共同构成AI新的Scaling Law,算法创新与算力堆叠在这条曲线上将一起狂奔,AI的能力边界将迎来新一轮的扩张。

【2】极致的工程优化:DeepSeek的真正创新之处在于极致的工程优化,主要依靠了如键值缓存icon,创新型的MoE架构,以及基于PTX层汇编语言icon实现对于英伟达iconGPU效率的极致压榨等等,通过这些创新性的工程优化,使得DeepSeek打破了西方模型公司固有的降本周期曲线,能够用更低的价格,来提供接近头部模型的使用体验,提高了全球算力的使用效率。

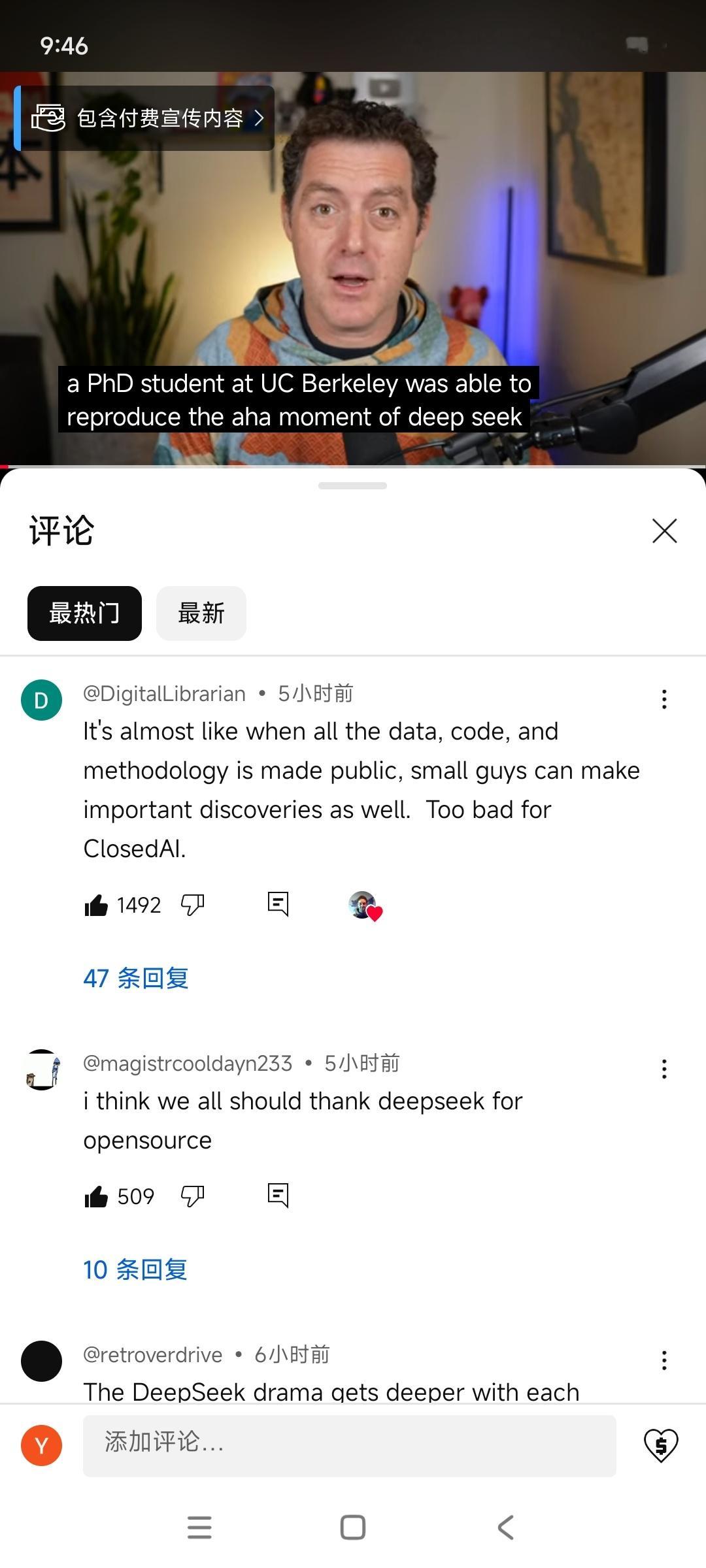

【3】慷慨的开源:与西方以OAI和Anthropic为代表模型巨头,逐渐走向闭源的模型商业理念不同,DeepSeek将自身创新性原理和模型进行了开源,一方面使得全球模型厂商能够共享新的工程方法带来的性价比提升,另一方面使得全球用户能够本地或者通过公有云部署,从而避免高溢价icon,这也是Deepseek在全球开发者中获得如此高殊荣的核心原因。

![不是,哥们,这AI成精了。[跪了][跪了]](http://image.uczzd.cn/9702002273826207532.jpg?id=0)