聊聊汽车上感知器的探测范围,现在量产的智能汽车上面的感知器,超声波雷达,摄像头、毫米波雷达、激光雷达都没能做到理论上需求的全方位覆盖。

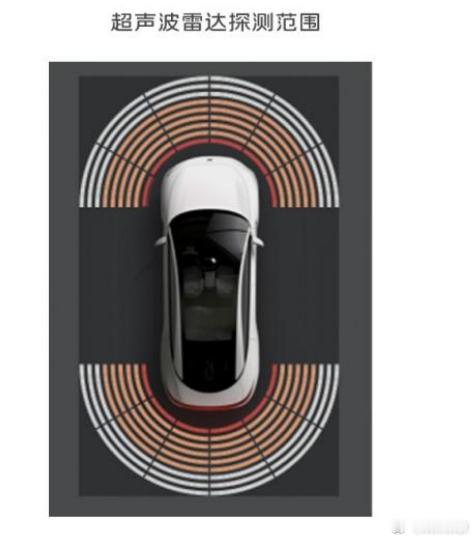

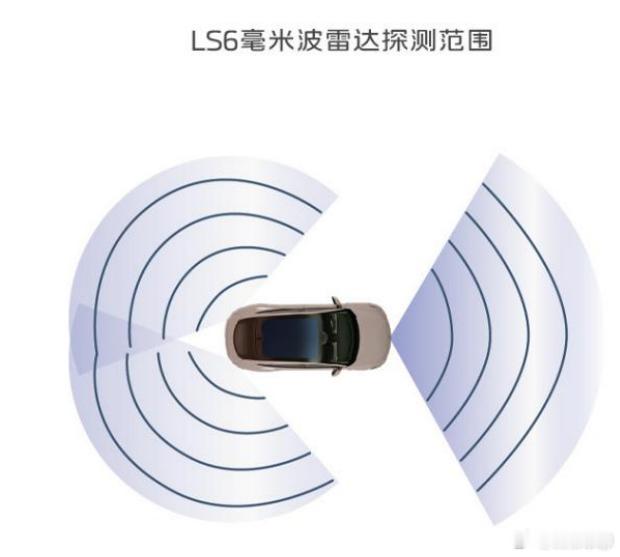

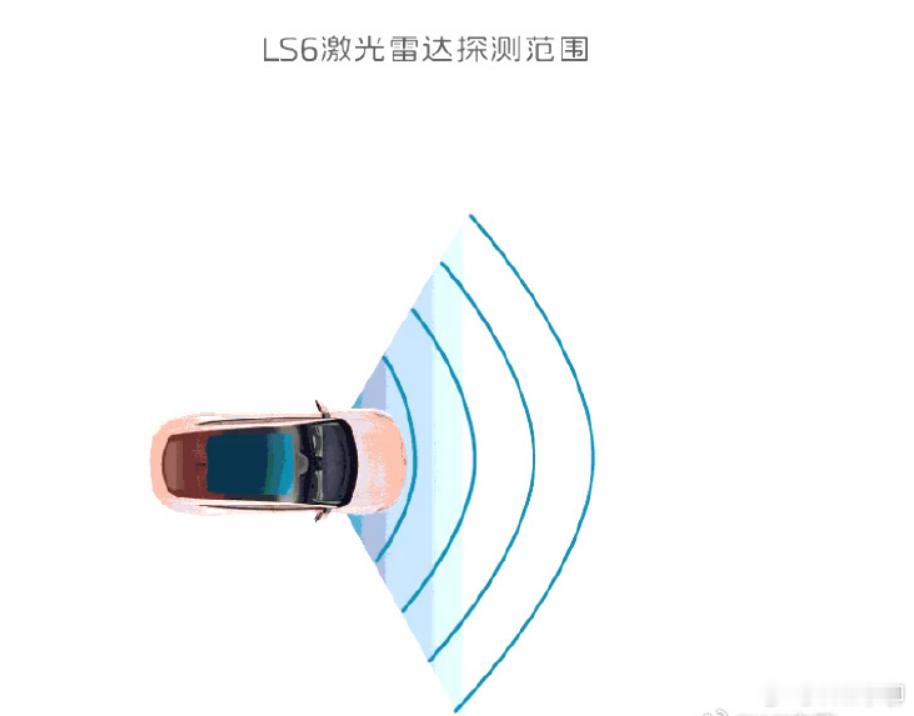

现在的量产车型上搭载的超声波雷达、毫米波雷达、激光雷达的覆盖范围(图一、二、三),在平面图上看,都是有缺失的盲区。

虽然车辆移动的时候,感知器也随之移动,能够动态覆盖车辆周围的场景,但依旧不可避免地会存在盲区。且越贵的感知器,比如激光雷达,因为成本限制,布置得过少,更会出现较大的盲区。

举个例子,装载在车顶上的向前的固定激光雷达并没有我们想象的那样,是可以覆盖很大一片范围的,而是只能覆盖向前很少的一部分区域。

这个可以从水平垂直视角看得出来,这种限定了视角的固定式的激光雷达,一般是120度的水平视角,25°的垂直视角。比如在车顶的向前激光雷达,车辆的侧面往往就是激光雷达扫描的死角,如果侧面没有毫米波雷达这种长距的感知探测,而侧面摄像头又没识别出靠近的车辆,就容易出现盲区无法探测所导致的事故。

举个常见的例子,就是开着智驾的车辆容易被侧面来车包住车头而发生事故。如果平时看过各类智驾事故的朋友,应该对这种场景不会陌生。

侧面车辆插进来,对于现阶段绝大部分智驾的感知来说都是盲区。

没有侧面毫米波雷达,没有侧面激光雷达,无法探测到侧面来车。

而侧面摄像头一般是提供给环绕视角的向下的短距摄像头,无论是视角还是视距,很难探测到远处来车。

加上侧面来车,肯定是斜着开过来。即便被侧面摄像头识别到了,但在侧面摄像头的视角中,侧方位来车只能看到一个车灯,小半个车头,并不是一辆车完整的车头。在AI训练中,这种小半截车头是很容易被误识别而作为杂乱信息被筛除的。

如果当时环境光线黯淡,摄像头看不清楚。那么侧面车辆斜插过来,包抄所驾驶车辆的车头,车辆即便开着智驾,但因为智驾的所有感知全部无效,智驾就有可能完全不减速,直接撞上插队车辆的事故发生了。

当然对此也有方案,就是把激光雷达往后放,这样就能扩大对侧面来车的视野了,但这样摆放,激光雷达的盲区依旧会出现。

而如果要实现真正的高阶智能驾驶,就不能有这种漏洞。

一般来说,如果要精准且远距离的感知侧方面来车或者什么动态障碍物,就要加上侧面的补盲激光雷达,至少左右各一颗激光雷达加上前置一颗激光雷达,来进行车侧和前方的远距离扫描,才能保障斜方向的动态障碍物靠近时候的感知。(图四)

而如果要做到面积上的全覆盖,那么前方、侧面、后面至少要有四颗定向激光雷达。如果要做到立体空间的全覆盖,那么全车至少要有8颗定向激光雷达才行。

而激光雷达因为其局限性,实际也是需要毫米波雷达和摄像头作为辅助的,如果要做到全方位的毫米波雷达和摄像头覆盖,这种成本,没有一个量产乘用车可以承受的了。

而硬件成本无法承受,就只有在软件上下功夫,工程师希望能通过不同感知器融合来扩大感知范围,比如AEB的毫米波雷达和摄像头的融合感知,比如激光雷达和毫米波雷达的融合感知,比如激光雷达和摄像头的融合感知。

但不同感知硬件的融合之路依旧不好走,要不然特斯拉也不会一门心思做纯摄像头感知的智驾方案了,即便摄像头在弱光环境和立体感上有着明显的弊端。

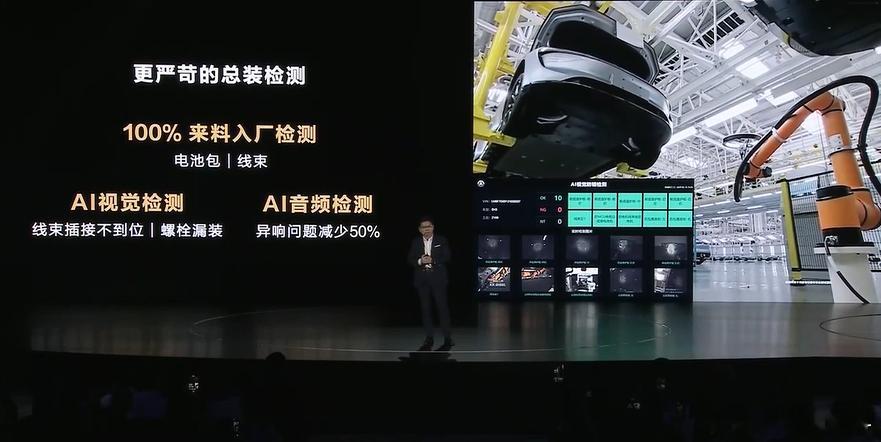

现阶段主流的高阶智能辅助驾驶,走的路线还是利用种类不同的感知器,密密麻麻遍布全车,还设置了冗余的感知器和冗余的算力,以免实际驾驶中出现问题。

但如果未来的感知设备大幅降价,比如定向激光雷达只要几百块一个,那么装满了感知设备,也搭载了适配的高算力芯片,那么是不是就能做到真正的高阶智驾了,消费者就可以放心大胆地让车辆自己开了。

答案还是不够。

因为车辆本身感知受限的原因,这样的智驾依旧不安全。比如十字路口的另一端,一辆卡车失控,无法踩刹车,卡车司机狂按喇叭冲过来。而车辆所有的智驾感知器都被拐角的建筑物所遮挡,无法知道侧面袭来的危机,那么车辆将会正常过红绿灯,最后被卡车撞到,车毁人亡。

所以,如果要实现真正的高阶智驾,还需要智能公路来配合了。