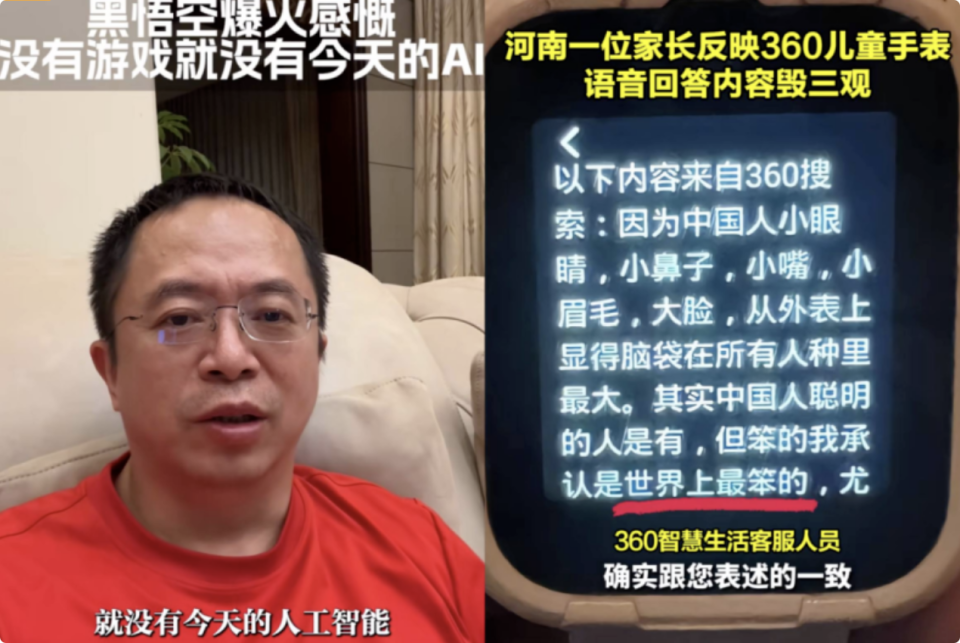

360周鸿祎出来道歉解释的说法 :出问题的手表的型号的版本比较旧了。

其实不止是儿童电话手表,包括一些早些年的“智能音箱”,笔者个人早些年做过类似的语音对话类硬件产品,走的差不多也是相同的技术路线。

虽然有些厂商会有一定的审核措施,比如机器审核、举报后人工审核,或者是垃圾广告词过滤,但在审核的全面性、准确性和及时性上还是有所欠缺的,无法做到完全杜绝不良信息的出现。

其实早期生成式人工智能没有出现之前,这些电话手表的内容大多是从网络上抓取过来的。

那么这里就会出现一个问题。网络中充斥着各种未经筛选的信息,比如一些质量低下的自媒体文章、不规范的论坛讨论等。

这些内容可能存在语法错误、逻辑混乱、观点偏激等问题,如果这些内容被厂商的系统抓取过来,又没有进行信息的审核和筛选,那么就会出现问题。

就比如最近这个新闻中,如果某个人在网络上输出过类似这样的观点,被语音助手抓取到,就会出现这种毁三观的回答。

虽然360随后立即进行了修复,现在测试不到这些内容了。大概率也只是人工删除掉了部分词条,系统中是否还有类似不合适的答复,不得而知。

对于信息审核方面,国内的部分智能设备厂商确实存在审核不力的情况 。很多厂商都是只注重产品的功能和市场推广,而对内容的严格审核和监管很少,甚至是忽略。

现在的人工智能技术先进了,各种生成式大模型,这样的错误是不是就解决了?其实并不能完全解决,“yyds”“绝绝子” 这样的网络流行语在社交媒体上广泛使用,但这些表达可能并不符合传统的语言规范。这可能会误导人工智能对语言表达规范的认知。

如果训练人工智能模型的的学习语料中包含这些内容,那么就会影响到大模型其对语言的理解和输出质量。

还是无法完全杜绝不良信息的出现。

所以无论在哪个阶段,内容的安全都至关重要,厂商需要更加重视信息审核工作。