编辑:LRST

【新智元导读】最近,来自上海大学、山东大学和埃默里大学等机构的研究人员首次提出了文本边图的数据集与基准,包括9个覆盖4个领域的大规模文本边图数据集,以及一套标准化的文本边图研究范式。该研究的发表极大促进了文本边图图表示学习的研究,有利于自然语言处理与图数据挖掘领域的深度合作。文本属性图Text-Attributed Graphs(TAGs)是一种在节点上有丰富文本信息的图结构, TAGs 广泛应用于社交网络(social network)、引用网络(citation network)和推荐系统(recommendation system)等实际场景中。由于其强大且通用的表达能力,该领域近年来得到了快速发展。

然而目前TAGs面临三大挑战:

1. 现有的TAGs数据集一般仅在节点上包含文本信息,而边的信息往往被简化为二元或分类属性。边文本(edge text)的缺乏限制了对文本实体间复杂语义关系的表达和理解(比如一个实体局部的一些概念如何与另一实体的局部相关),阻碍了图数据挖掘技术的进一步发展;

2. 文本图数据格式和实验设置不统一,难以进行模型之间的比较;

3. 由于缺乏全面的基准测试和分析,对图模型处理边文本信息能力仍然了解的很欠缺。

论文地址:https://arxiv.org/abs/2406.10310

代码地址:https://github.com/Zhuofeng-Li/TEG-Benchmark

数据集地址:https://huggingface.co/datasets/ZhuofengLi/TEG-Datasets

为了解决这一问题,上海大学、山东大学、埃默里大学等学术机构的研究人员联合推出了TEG-DB,一个全面的基于文本边的图数据集和基准测试(A Comprehensive Dataset and Benchmark of Textual-Edge Graphs)。

目前,论文已被NeurIPS Datasets and Benchmark Track 2024接收。

其主要有三个特点:

1. TEG-DB datasets提供了涵盖4个领域9个统一格式的TEG数据集,规模从小到大不等,均包含丰富的节点和边的原始文本数据,这些数据集填补了TEGs领域的空白,旨在为相关研究提供重要数据集资源。

2. 研究人员开发了TEGs研究的标准化流程,涵盖数据预处理、加载和模型评估等关键阶段。

3. 研究人员进行了广泛的基准实验,并对基于TEGs的方法进行了全面分析,深入探讨了不同模型及不同规模pre-trained language models(PLMs)生成的嵌入的效果、在GNNs中使用分离和交织嵌入方法(seperate and entangled embedding methods)的影响、边文本的作用以及不同领域数据集的影响。

TEG Datasets

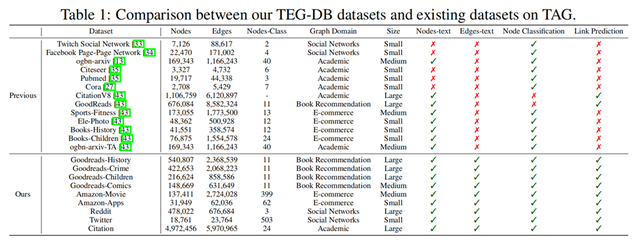

TEG Datasets为了构建同时满足节点和边具有丰富文本信息的数据集,研究人员选择了来自不同领域和规模的9个数据集。

具体包括4个来自Goodreads的图书推荐领域用户-书籍评论网络,2个来自Amazon的电商购物网络,1个来自Semantic Scholar的学术引用网络,以及 2个来自Reddit和Twitter的社交网络。数据集统计请见下表:

TEG Methods

TEG Methods基于 PLM 的范式

PLM通过大规模文本训练,能够理解词语、短语和句子的语义关系和上下文。

基于PLM的方法首先将TEG中节点和边的文本通过PLM进行嵌入表示 (embed),

例如对于节点u,通过embed其自身以及所连接的边文本,可以得到 embedding

作为节点u

初始化特征 (feature) 。之后使用多层感知器(MLP)整合TEG中的语义信息,获得最终的节点表征。公式如下:

其中,

表示第k层MLP中节点u的表示,Tu和

分别为节点u和连接节点v与u边ev,u的原始文本,节点v是u的邻居,ψ为MLP的可训练参数。

尽管PLM显著提升了节点的表征能力,但由于未考虑TEG拓扑结构,限制了其对TEG中完整语义信息的捕捉。

基于 Edge-aware GNN 的范式

GNN通过消息传递 (message passing)来提取图结构中有意义的表征信息,具体定义如下:

其中,

表示GNN第k层中节点u的表征,初始特征向量

通过使用PLM对节点的原始文本进行embed获得。从节点v到节点u的边,其特征ev,u同样由PLM对于边的原始文本进行embed得到。k代表GNN的层数,N表示邻居节点集合,u为目标节点,ω为GNN中的学习参数。

然而,这种方法存在两个主要问题:

1. 现有的图机器学习方法如GNN对于边通常基于连通性(即二元属性表示是否有连接)和边属性(如类别或数值属性)进行操作,而非基于文本属性。然而在TEG中,边包含了丰富的文本,这便导致GNN远不足以处理这些复杂的文本信息所产生的语义关系。

2. 基于GNN的方法在捕捉节点以及边文本的上下文语义方面存在局限性。在TEG中,边和节点的文本通常交织在一起,在嵌入过程中将它们分别进行嵌入表示(seperate embedding),可能导致相互依赖关系信息的丢失,从而削弱GNN在整个消息传递过程中的有效性。

基于Entangled GNN的范式

传统GNN方法将边和节点文本分离进行嵌入(seperate embedding),可能导致大量信息损失,特别是在TEG中。

例如,在一个citation network中,每个节点表示一篇论文,一条边可能表示某篇论文引用、批评或使用了另一篇论文的某一部分。

因此,边文本是不能独立于论文节点存在的,这便对节点以及边seperate embedding方法提出了挑战。

为避免文本嵌入后节点和边交互时的信息丢失,提出了一种新的方法 Entangled GNN,先将边文本和节点文本Entangle在一起,再进行embed,作为节点的初始化embedding。随后对节点进行消息传递操作。

该方法的公式如下:

其中,

表示GNN第k层中节点u的表示。Tv、Tu和

分别表示节点v、节点u及其连接边的原始文本。k为GNN的层数,N表示邻居节点集合,u为目标节点,ω为GNN中的学习参数。

相比于现有方法,该方法的优势在于能够有效保留节点与边之间的语义关系,更适合捕捉复杂的关系。

LLM as Predictor 的范式

利用LLM强大的文本理解能力,LLM可以直接被用于解决图级别问题。具体而言,为每个数据集采用一个包含相应的节点和边文本的text prompt,从而让LLM回答特定问题,例如节点分类或链接预测。

可以正式定义如下:

其中,f是提供图信息的prompt,G表示一个TEG,Q为问题。

TEG实验结果Baselines在基于PLM的范式中,使用三种不同规模的PLM对节点文本进行编码,以生成节点的初始嵌入。三种模型分别是:大模型GPT-3.5-TURBO,中型模型Bert-Large,以及小型模型Bert-Base。

在基于Edge-aware GNN的范式中,选择了五种流行的Edge-aware GNN模型:GraphSAGE、GeneralConv、GINE、EdgeConv和GraphTransformer。使用与PLM范式相同的三种规模的PLM对节点和边的文本进行编码,之后这些文本嵌入作为节点和边的初始特征。

在基于Entangled GNN的范式中,实验设置与Edge-aware GNN相同除了使用Entangled方式通过GPT-3.5-TURBO对于节点和边的文本进行编码。

在LLM as Predictor的范式中,选择通过API访问GPT-3.5-TURBO和GPT-4,以平衡性能和成本。

Node Classification下表展示了不同数据集上节点分类在中的效果:

Link Prediction

Link Prediction下表展示了不同数据集上链接预测的效果:

总结

总结研究人员推出了首个Textual-Edge Graph基准,TEG-DB,旨在深入研究TEG上的图表示学习。

与传统的仅包含节点文本信息的TAG不同,TEG涵盖了节点和边的文本内容。

研究人员收集并提供了9个全面的TEG数据集,以促进NLP和GNN社区对于TEG的合作与探索,其Benchmark对各种学习方法进行了全面评估,确认了它们的有效性和局限性。

此外,研究人员计划继续挖掘和构建更多研究导向的TEG,以推动该领域的持续发展。

团队介绍

文章第一作者为上海大学的本科生李卓风,通讯作者为埃默里大学计算机系的赵亮教授。

共同作者包括埃默里大学的博士生胡云桐、张铮、凌辰,本科生 Sirui Li,中国石油大学本科生刘众源,约翰·霍普金斯大学硕士生 Xiangnan Zhang,山东大学本科生 Zixing Gou。